2024年5月24日、ついに Azure OpenAI でも GPT4o が正式にリリースされました。

AI の大規模言語モデルの進化は日々その速度を増しており、その最新のモデルが “GPT4o” です。

では、その最新モデルではどんなことができるのか確認していきましょう。

GPT4o とは?

GPT4o は、OpenAI によって開発された最新の言語理解 AI モデルで、前モデルである GPT4 の機能を大幅に拡張したものです。GPT4o は、マルチモーダルな特徴を有しており、これはテキストデータだけでなく、視覚や聴覚からの情報も同時に処理できることを意味します。GPT4o は、画像内のシーンを言葉で描写したり、音声メッセージをテキストに変換したりするなど、多次元的なデータ解析を行うことができます。

一言で表すなら「より人間的な処理」ができるようになったモデルと言えます。

利用可能リージョン

現時点では GPT4o は以下のリージョンのみで利用可能です。

残念ながら、2024年6月6日現在、日本リージョンでの利用は不可になっています。

早く日本リージョンでも利用可能になればいいですね。

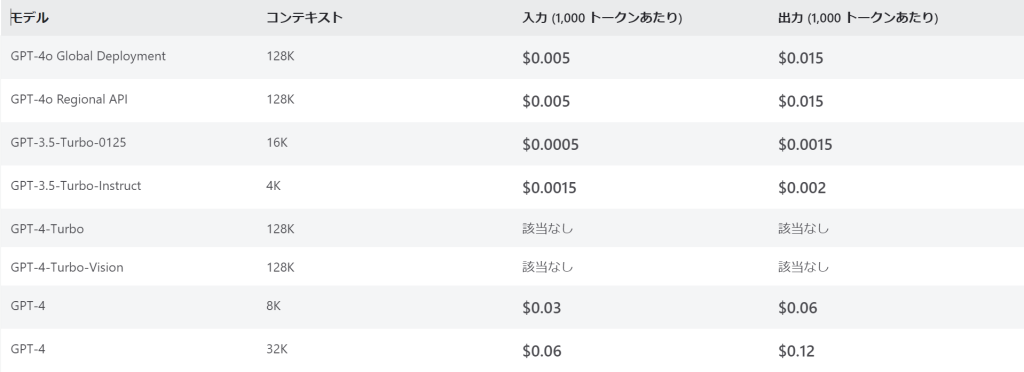

料金について

料金は以下の表の様になっています。

性能が上がった分、料金もあがるかと思いますが、今回は料金がさがっています。

少なくとも料金面においては利用しない理由がないですね。

性能確認

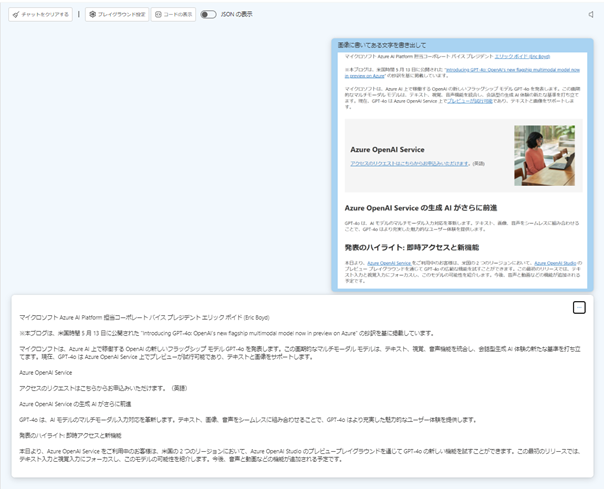

今回は画像認識(OCR)機能を使って性能を確認してみましょう。

以下のプロンプトを実行したときの、認識率・応答速度を確認していきます。

630文字程度のスクリーンショットを文字起こしすると結果は……

- 認識率:100%

- 応答速度:約15.0秒

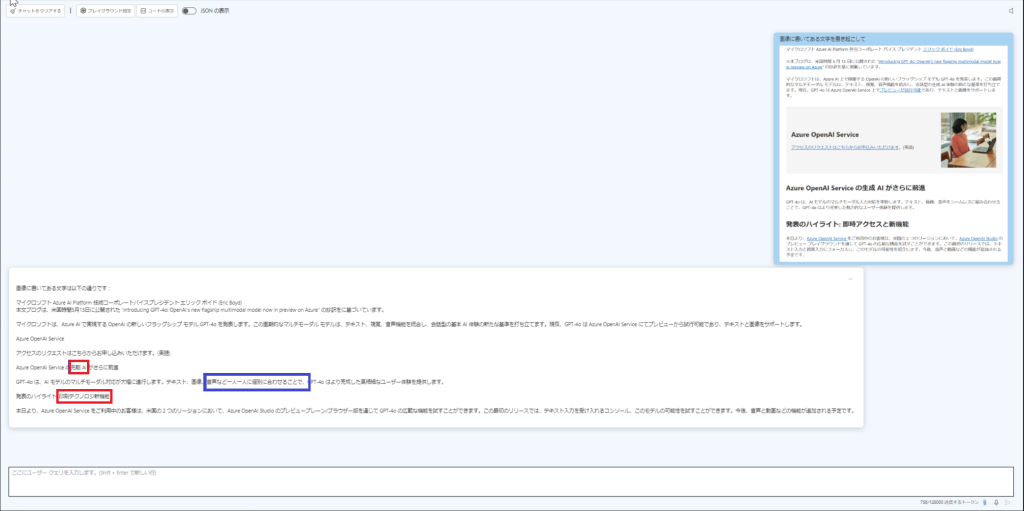

GPT4-Turbo-Vision ではどうなるでしょうか?結果は以下の様になりました。

- 認識率:約97%

- 応答速度:約20.0秒

*画像赤枠が誤字・青枠が文字抜け

正確性・応答速度ともに GPT4o の方が性能が上という結果になりました。

これまでは、目的によってモデルを使い分けながら構築する必要がありましたが、今回実施した画像からの文字の読み取り(OCR)や、音声を文字に起こす作業が一つのモデルで完結できるのは凄く便利ですね。 皆さんもぜひ Azure OpenAI GPT4o を利用してみてください!